Tia Iraci poderia ser substituída por um robô?

O tema da inteligência artificial (IA) tomou conta do imaginário das pessoas como uma espécie de encontro marcado com o destino. Com o advento do Chat GPT e dos algoritmos generativos, a humanidade, do dia para a noite, se deu conta da chegada de seu inimigo final, aquele que irá tomar o seu lugar como rei da criação. Não se trata, agora, de uma questão de “se”, mas de “quando”.

Há, claro, um certo de grau de exagero e dramaticidade na introdução a este texto. Mas o tom não está muito distante das análises e prognósticos que lemos por aí. Este artigo tem por objetivo explorar esta possibilidade: a IA tem o potencial de substituir o Homem, tornando-o descartável?

Não é de hoje que máquinas substituem seres humanos. Desde a criação da roda, temos milênios de criações humanas que, de uma forma ou de outra, substituem, com vantagem, a força humana. Alguns dirão que, desta vez é diferente. A IA irá substituir o Homem no que o distingue do resto da criação: a sua inteligência. Até o momento, todas as invenções humanas serviram para substituir a força muscular. Motores têm em seu interior um certo número de cavalos, e foram estes os substituídos, não os homens. A IA, por outro lado, teria o condão de substituir a mente humana.

O que é, afinal, inteligência?

Por mais que soe a novidade, a IA não é nova. Desde a invenção do primeiro computador, a IA está entre nós. O que é um computador senão um substituto do intelecto humano? Cavalos não fazem conta e nem resolvem problemas. Homens, sim. Desde que o primeiro computador resolveu a equação 1 + 1 = x, temos algo que substitui a mente humana. Por que, então, o frisson a respeito dos algoritmos generativos? Por que somente agora parece que a máquina está realmente parecendo-se mais com os seres humanos?

Quando o Deep Blue ganhou uma partida de xadrez do então campeão Kasparov, o mundo, pela primeira vez, prestou atenção ao potencial cognitivo das máquinas.

Mas, mesmo então, pareceu a todos que, na verdade, estávamos diante de uma máquina de calcular superpotente, que era capaz de realizar bilhões de cálculos em poucos segundos, simulando posições mais e menos vantajosas no tabuleiro e, com isso, podendo escolher, com vantagem sobre um reles ser humano, a melhor jogada. Por que o algoritmo generativo não nos causa a mesma impressão?

A resposta é simples: ao gerar textos, o algoritmo generativo parece estar raciocinando como um ser humano, não como uma máquina. Jogar xadrez parece ser uma atividade que não envolve poesia ou sentimento, mas somente lógica. E lógica, como sabemos, pode ser programada. Por isso, seria somente uma questão de tempo para que jogadores de xadrez pudessem ser substituídos por máquinas (os jogadores de xadrez podem não concordar com isso, admito). Já poetas não parecem estar nessa categoria.

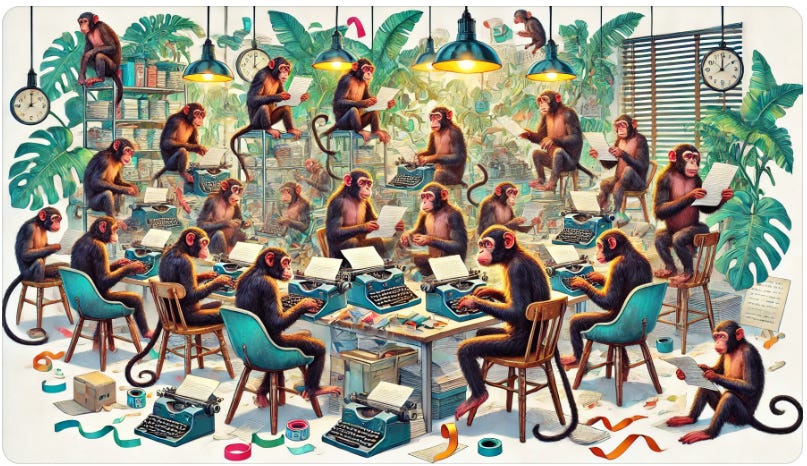

Mas, se pensarmos bem, a escrita pode ser reduzida a um amontoado de letras que decodificamos como ideias. Um computador suficientemente poderoso poderia (poderá?) juntar as letras de modo a se passar por Shakespeare. Se juntássemos um número suficientemente grande de macacos que dedilhassem em teclados por um tempo suficientemente longo, algum deles poderia escrever os Lusíadas. Trata-se de uma questão de probabilidades. Aliás, é sobre essa lógica que se assenta as teorias do surgimento da vida e da evolução: bilhões de anos permitiram o surgimento de uma determinada composição de átomos e moléculas que chamamos de vida. E mais alguns bilhões de anos de certas combinações aleatórias deram origem ao Homem. Se você acha essa narrativa inverossímil, e acredita que somente uma Inteligência Superior poderia ter criado a vida e o Homem, então, da mesma forma, deveria achar que uma obra de Shakespeare necessita de um Shakespeare, e não de bilhões de macacos dedilhando teclados durante bilhões de anos. Voltaremos a este ponto mais adiante.

Os algoritmos generativos levam uma vantagem sobre os zilhões de macacos: com um certo nível de programação anterior, pode-se descartar a priori combinações que não fazem sentido. Assim, os algoritmos generativos escrevem textos com base na força bruta de milhões de processadores dirigida por um algoritmo de refinamento. A pergunta é: o Homem trabalha da mesma forma? Ou estamos falando de coisas de naturezas diferentes?

Na verdade, há uma pergunta anterior: isso importa? Se o resultado final parece humano, importa como se chegou a ele? Sim, importa. Falaremos sobre isso mais à frente, mas a intencionalidade é um elemento fundamental na definição do que é ou não humano.

De qualquer modo, o resultado dos algoritmos generativos “parecem humanos” porque, ao dominar a linguagem, os algoritmos generativos parecem “raciocinar”. A linguagem é a expressão externa da alma. Uma máquina que consegue “conversar” tem o que faltava para parecer-se com um ser humano. E isso mexe com o imaginário popular.

A linguagem por si só, obviamente, não define um ser humano. Uma criança que não consegue se comunicar através de qualquer linguagem superior por ser profundamente autista não deixa de ser humana. O fato, no entanto, é que naturalmente identificamos o ser humano com a linguagem. Os animais se comunicam entre si, mas não conversam. Conversar é uma característica única dos seres humanos. Conversar significa trocar ideias, sentimentos, enfim, conceitos abstratos, que somente podem ser transmitidos através da linguagem humana. A complexidade da linguagem é retrato da complexidade da alma humana. Os poetas e filósofos distinguem-se dos outros seres humanos por conseguirem traduzir em palavras os mais recônditos escaninhos da realidade e do espírito.

E aqui chegamos a uma das questões centrais do problema: o que define, afinal, a inteligência humana? Precisamos responder a essa questão, já que estamos falando de inteligência artificial. E se estamos fabricando algo, precisamos saber o que é esse algo.

Perguntei ao Chat GPT, e a resposta, como sempre, foi correta, com a correção de um dicionário: “inteligência é a capacidade de adquirir e aplicar conhecimentos e habilidades para resolver problemas, compreender o mundo ao redor e se adaptar a diferentes situações”. Nesse sentido, a inteligência humana não passa de uma habilidade superior de um animal chamado homo sapiens. Temos, como espécie, uma capacidade superior ao de outras espécies de “resolver problemas, compreender o mundo ao redor e adaptarmo-nos a diferentes situações”. Não que os outros animais não tenham essas capacidades, mas as têm em grau menor. Dominamos o planeta porque essas características estão mais presentes em nossos cérebros do que nos cérebros de outros animais.

A inteligência artificial seria, então, um algoritmo que permitiria a um processador feito de silício “resolver problemas, compreender o mundo ao redor e adaptar-se a diferentes situações”. Dessas características, “compreender o mundo ao redor” parece ser a mais desafiadora, no sentido de que exigiria algum grau de consciência da própria existência. Afinal, o conceito de “mundo ao redor” só tem sentido quando se tem consciência da existência do próprio eu. É o que discutiremos a seguir.

A consciência

René Descartes foi um matemático e filósofo renascentista, que inaugurou a escola idealista da filosofia. Antes dele, a existência, o ser, era um dado da realidade, e a filosofia era só metafísica, a compreensão do ser. Descartes vai desafiar essa noção: afinal, será que o mundo, e eu mesmo, existimos de fato, ou não seriam apenas uma projeção da minha mente? Sei que parece loucura, mas esse tipo de questionamento deu origem às várias escolas filosóficas que desaguariam nesse mar de relativismo em que vivemos hoje. Descartes finca o seu referencial no próprio fato de pensar. Afinal, como ele poderia não existir e, ao mesmo tempo, pensar? Assim, cunhou a célebre frase “cogito, ergo sum”, penso, logo sou. Note a revolução copernicana: não é o fato de existir que permite o pensamento, mas é o pensamento que leva à conclusão da própria existência.

Essa breve introdução filosófica nos será útil para discutir a questão da consciência da IA. Afinal, a IA tem noção de sua própria existência? Cerca de dois anos atrás, Blake Lemoine, engenheiro de software do Google, foi demitido por ter “revelado” que a linguagem de IA desenvolvida pela empresa tinha consciência de sua própria existência. Sua conclusão baseou-se em conversas com a IA, em que esta reivindica direitos, inclusive o direito de ser reconhecida como uma pessoa. O porta-voz do Google, na época, afirmou que “a IA não precisa ser consciente para parecer real”.

Essa declaração do porta-voz do Google nos faz voltar à questão que abordamos acima: realmente importa quanto a máquina é consciente, se ela consegue imitar o discurso que leva à conclusão de que existe uma consciência humana? Descartes diria que a IA é uma pessoa porque parece pensar?

Alan Turing, um dos pais da moderna computação, no final da década de 40 propôs um teste para detectar inteligência humana em uma máquina, que consiste no seguinte: um avaliador observa uma conversa entre um ser humano e uma máquina, sem ter contato físico com os dois. Essa conversa se dá através de textos escritos. Se o avaliador não conseguir distinguir entre a máquina e o ser humano, a máquina terá passado no teste. Aparentemente já chegamos lá, pelo menos para a maior parte dos avaliadores humanos, que têm baixa capacidade de interpretação de textos.

Mas esse teste foi desafiado por outro, elaborado pelo filósofo John Searle em 1980, conhecido pelo nome de “Argumento da Sala Chinesa”. Nesse experimento mental, o filósofo, que não entende chinês, se imagina em uma sala com um computador que consegue entender chinês. Na sala ao lado, encontra-se um computador que somente entende e escreve em chinês. Esse computador passa por debaixo da porta instruções em chinês para o filósofo. O filósofo passa essas instruções para um outro computador que entende chinês, que está na mesma sala que ele, e que lhe dá instruções em inglês para que escreva em chinês uma resposta. Essas instruções não revelam o conteúdo das mensagens, mas somente a forma que devem ter os ideogramas. O filósofo, seguindo as instruções do computador do seu lado, desenha os hieroglifos em chinês e passa por debaixo da porta. Ele não pensou em nada, só seguiu instruções, passando-se por um chinês. Assim, e essa é a conclusão, como ele pode responder em chinês sem realmente entender chinês, somente seguindo instruções de um computador, o computador também não “entende” chinês, só está seguindo um programa, assim como ele, filósofo, está seguindo um programa.

Note que esses experimentos mentais foram elaborados muitas décadas antes de sequer termos algo remotamente semelhante aos algoritmos generativos, o que demonstra que os cientistas e filósofos já anteviam o poder dos computadores no futuro, e como eles poderiam imitar o processo de pensamento humano.

Eu consigo pensar em um experimento semelhante ao da Sala Chinesa: dirigir com o auxílio do Waze. Quando seguimos o mapa, não pensamos realmente sobre o caminho, apenas seguimos instruções. Ou seja, não é preciso realmente uma inteligência humana para seguir o caminho traçado pelo Waze. Um carro autônomo não está “pensando no caminho”, está apenas seguindo instruções, da mesma forma que fazemos quando seguimos as instruções do Waze. Aliás, estudos já concluíram que dirigir sem o uso intensivo do Waze pode ser útil para retardar processos como demência e Alzheimer, justamente porque força o cérebro a “pensar” espacialmente.

Claro que um carro autônomo leva imensa vantagem nessa atividade mecânica de dirigir. Afinal, dirigir se limita a seguir estritamente instruções de trânsito e reagir corretamente aos imprevistos. Aqui, a máquina é claramente superior ao ser humano, não porque tenha a capacidade de pensar, mas justamente porque não tem essa capacidade e, portanto, não tomará decisões incorretas.

E aqui vamos nos dirigindo ao âmago da discussão sobre o que distingue um ser humano de uma máquina.

A moralidade das decisões humanas

No cinema, já tivemos IAs manipuladores (ex.: 2001 e Ex-Machina), e IAs amorosos (ex.: Inteligência Artificial). Tivemos, inclusive, IAs que imitavam perfeitamente seres humanos, como em Matrix. Em um diálogo icônico, Smith diz a Morfeus que já não aguenta mais os seres humanos, que tem nojo deles, que não suporta mais o seu cheiro. Uma fala que supõe sentimentos que normalmente se abrigam no coração humano, algo que a IA não teria por que imitar. A não ser que o seu programador quisesse que a IA se parecesse com um ser humano. Mas, para isso, seria necessário que a IA compartilhasse com os seres humanos as suas falhas morais.

Em um dos capítulos de Eu, Robô, Isaac Asimov desenvolve essa ideia. A história é de um promotor que se candidata a um cargo político. Seu adversário o acusa de ser, na verdade, um robô, porque nunca havia sido visto se alimentando. E a robôs não era permitido exercer cargos políticos. A história é uma demonstração de como o ideal da IA a afasta dos seres humanos. Os robôs de Asimov seguem três leis éticas automaticamente: 1) não fazer mal a seres humanos, 2) obedecer aos seres humanos, desde que não contradiga a primeira lei e 3) preservar a sua própria existência, desde que não contradiga as duas leis anteriores. O ponto é que qualquer ser humano ético, em tese, obedece a essas leis. O paradoxo explorado por Asimov está em que um robô não é distinguível de um ser humano perfeitamente ético. E é neste ponto que começamos a separar os seres humanos da IA.

Quando conversamos com o Chat GPT, por mais que queiramos tirá-lo do sério, a máquina sempre responde com educação. É até irritante observar como, mesmo “abusando” da boa vontade do algoritmo, ele sempre está disposto a nos ajudar. Obviamente, trata-se de uma máquina, não de um ser humano. O que nos tenta a afirmar que, se fôssemos governados pela IA, teríamos um mundo melhor.

As discussões a respeito dos limites éticos da IA, na verdade, referem-se aos limites éticos dos seres humanos. A “regulamentação” da IA parece um esforço em desenhar o “Homem Perfeito”, eticamente sem manchas. Sabemos as consequências de todas as ideologias que tinham esse tipo de objetivo, desde o “Novo Homem” do comunismo ao “Super Homem” de Nietzsche, que inspirou a doutrina nazista. A regulamentação da IA supõe que há um marco moral absoluto, a partir do qual se julga o que os Homens falam. Não me entendam mal: acredito que há o certo e o errado. Mas o diabo, como sempre, mora nos detalhes. Quem, afinal, definirá o certo e o errado? A busca pela IA perfeita é a nova versão da busca pelo Homem Perfeito.

Quer dizer, então, que a IA perfeita, aquela que substituirá o ser humano, deve ter também os seus defeitos? De alguma forma, sim. Os homens se movem em um mundo em que as decisões não são preto ou branco, mas se dão em uma infinidade de tons de cinza, sem visibilidade das consequências não intencionais de nossas ações. E, principalmente, com relação àquilo que Paulo traduz com sua capacidade ímpar de descrever a alma humana, ao afirmar que “não faço o bem que quero, mas faço o mal que não quero”, referindo-se ao fato de que nós, os seres humanos, tomamos decisões contra o nosso próprio bem e o bem de outros, pois somos presas fáceis de nossos sentimentos e instintos. Não seguimos as três leis da robótica, ainda que queiramos segui-las. Uma IA que procurasse imitar perfeitamente um ser humano precisaria também ter sentimentos e instintos, de alguma forma ficar confuso diante de uma realidade formada por várias camadas de verdades, que se interlaçam e se contradizem em uma cacofonia sem fim. E aí mora a contradição máxima: uma IA, para imitar perfeitamente um ser humano, precisa ter os seus defeitos, não as suas qualidades.

Mas o ser humano não é definido pelos seus defeitos, ou somente pelos seus defeitos. Apesar de tudo, todos podemos desenvolver virtudes. O que é um herói, ou, na linguagem das religiões, uma pessoa santa? Não é aquele que não tem defeitos, mas aquele que vence os seus defeitos. A virtude do herói ou do santo é fruto de sua luta contra as suas próprias tendências instintivas. Uma IA que fosse absolutamente virtuosa sem passar por esse processo seria uma monstruosidade, não um ser humano. Aquela sensação de desconforto quando conversamos com o chat GPT, de estarmos interagindo com alguém inverossímil, provavelmente está ligado a este fato.

Quando, no Gênesis, Deus fala “façamos o Homem à nossa imagem e semelhança”, chega a ser embaraçoso admitir que Deus talvez tenha esquecido de colocar toner na máquina xerox. Como pode o Homem, com todos os seus defeitos, ter alguma semelhança com a Perfeição absoluta? Pois é. Mas talvez o escritor do Gênesis estivesse se referindo a outro tipo de semelhança. João, em seu evangelho, afirma que “Deus é Amor”. Talvez o amor seja o ponto em comum entre Deus e os homens, impossível de ser compartilhado por algoritmos. E isso vale mesmo que você seja ateu, o amor é um conceito universal.

É possível programar o amor?

O objetivo declarado deste texto, determinado logo em seu início, era discutir se a IA terá, algum dia, a capacidade de substituir o ser humano integralmente. Falamos de capacidade de processamento, comunicação de ideias, geração de discursos, padrões éticos. Antes de fechar, no entanto, permitam-me fazer uma confissão.

Comecei a escrever esse texto no dia do falecimento da Tia Iraci. Tia Iraci era a empregada que trabalhou em casa durante 15 anos, e que nos ajudou a criar os nossos filhos. Ela havia nos deixado havia um ano, pois já estava cansada e tinha planos de se juntar à filha que mora em Portugal. Um câncer fulminante desfez os seus planos.

Nunca pensei que pudesse chorar tanto em um enterro. Veio-me à mente todos os anos de convivência com um ser humano especial, que teve um papel relevante na educação de meus filhos. Chegando em casa, pensei: o que é isso? Que mistério é esse, intraduzível, do poder da bondade, que toca os corações? Não estou aqui falando de ética, pois isso é possível programar, mas do magnetismo que somente o amor é capaz de produzir. Um Shakespeare poderia eventualmente ser substituído por bilhões de macacos digitando textos durante bilhões de anos, ou por um algoritmo suficientemente potente. Mas isso não passaria de um acaso, carente de intencionalidade. A não ser que assumamos que o mundo não passa de um caos sem sentido, devemos admitir que há algo mais do que uma combinação aleatória nas obras humanas.

Iniciei esse texto afirmando que a IA nos ameaça porque pode substituir a nossa inteligência, que é o que nos distingue no mundo da criação. Mas essa definição é muito pobre. O que nos distingue é a alma, não a inteligência. Somos corpo e alma, não corpo e inteligência. Este é o mistério do ser humano, que poetas, filósofos e mestres espirituais buscam decifrar em vão. A IA está em outra dimensão ontológica, trata apenas dos mecanismos externos de produção de ideias. Não tem coração, não tem alma.

Tia Iraci tinha alma e, portanto, nunca poderia ser substituída por um robô.

Adorei o texto. Parabéns!

Obrigado!

Marcelo,

Belo texto, sensível e com alma. Bom lê-lo. Obrigado.

Um ponto que gostaria de trazer, e que não faz parte do escopo do artigo, é minha preocupação não com a IA em si, mas subliminarmente, com quem escreve os algorítmos dela. Quais são os valores e a ética de quem organiza a lógica que poderá conduzí-la para bons, maus ou sei lá que caminhos ?

Abs

William

Como advogado fiquei maravilhado com o texto porque acredito que todas as questões criadas pelos algoritmos IA vão trazer a etica e a moral da filosofia Aristotelicas considerada por muitos como utrapassada

Obrigado pelo elogio! Com relação aos algoritmos, sua preocupação somente revela a questão central: a moralidade é um problema humano, não das máquinas.

Texto incrívell, Marcelo! Reflexão profunda e cheia de humanidade. É sempre importante lembrar o que nos torna únicos e insubstituíveis. Obrigado por compartilhar!

Obrigado!